如何通过Spark的IDE搭建并测试Spark开发环境

本篇内容介绍了“如何通过Spark的IDE搭建并测试Spark开发环境”的有关知识,在实际案例的操作过程中,不少人都会遇到这样的困境,接下来就让小编带领大家学习一下如何处理这些情况吧!希望大家仔细阅读,能够学有所成!

黄陵ssl适用于网站、小程序/APP、API接口等需要进行数据传输应用场景,ssl证书未来市场广阔!成为创新互联的ssl证书销售渠道,可以享受市场价格4-6折优惠!如果有意向欢迎电话联系或者加微信:18980820575(备注:SSL证书合作)期待与您的合作!

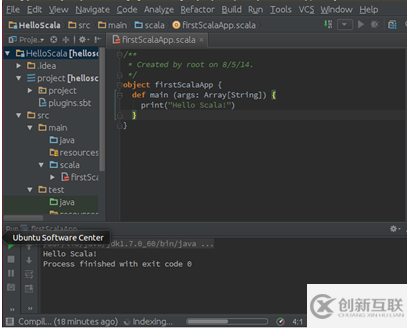

通过Spark的IDE搭建并测试Spark开发环境

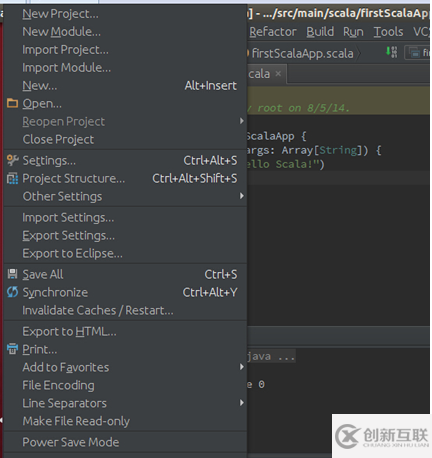

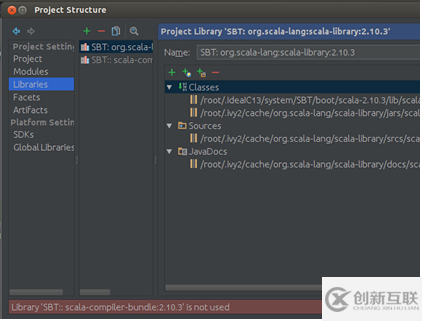

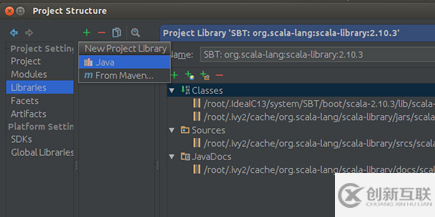

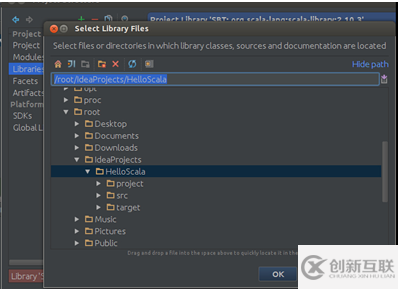

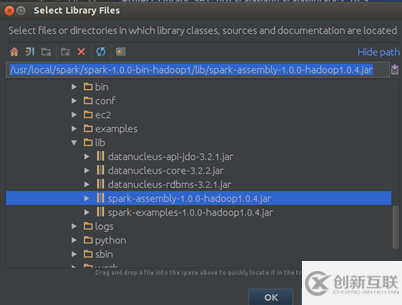

Step 1:导入Spark-hadoop对应的包,次选择“File”–> “Project Structure” –> “Libraries”,选择“+”,将spark-hadoop 对应的包导入:

点击“OK”确认:

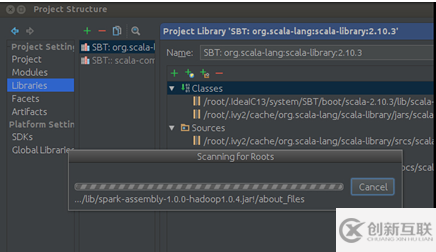

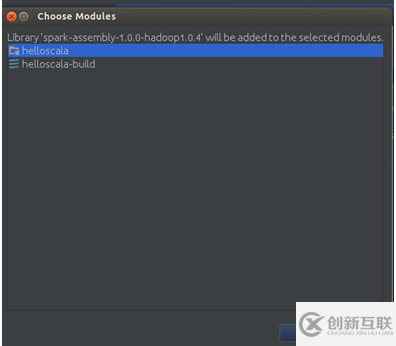

点击“OK”:

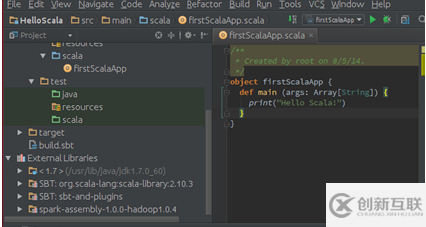

IDEA工作完成后会发现Spark的jar包导入到了我们的工程中:

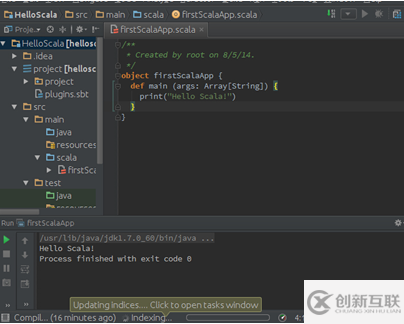

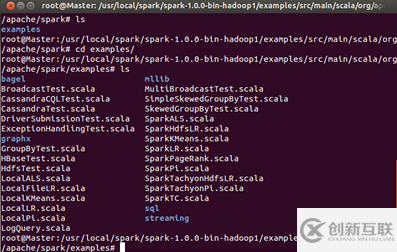

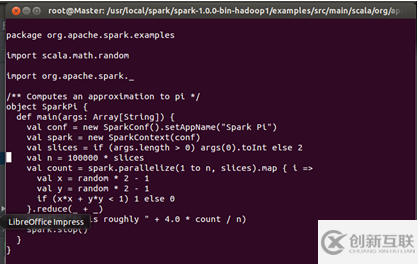

Step 2:开发第一个Spark程序。打开Spark自带的Examples目录:

此时发现内部有很多文件,这些都是Spark给我提供的实例。

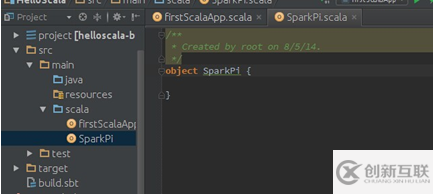

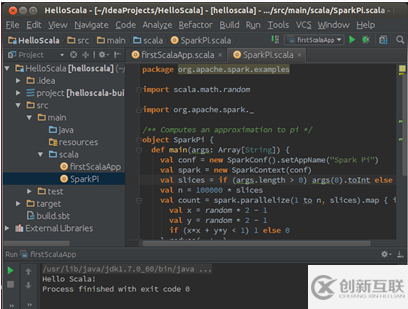

在我们的在我们的第一Scala工程的src下创建一个名称为SparkPi的Scala的object:

此时打开Spark自带的Examples下的SparkPi文件:

我们把该文的内容直接拷贝到IDEA中创建的SparkPi中:

“如何通过Spark的IDE搭建并测试Spark开发环境”的内容就介绍到这里了,感谢大家的阅读。如果想了解更多行业相关的知识可以关注创新互联网站,小编将为大家输出更多高质量的实用文章!

网站题目:如何通过Spark的IDE搭建并测试Spark开发环境

浏览地址:https://www.cdcxhl.com/article44/ghohhe.html

成都网站建设公司_创新互联,为您提供外贸建站、动态网站、全网营销推广、小程序开发、定制网站、建站公司

声明:本网站发布的内容(图片、视频和文字)以用户投稿、用户转载内容为主,如果涉及侵权请尽快告知,我们将会在第一时间删除。文章观点不代表本网站立场,如需处理请联系客服。电话:028-86922220;邮箱:631063699@qq.com。内容未经允许不得转载,或转载时需注明来源: 创新互联

- 创新互联免费虚拟主机申请流程 2021-03-19

- 虚拟主机和云主机相比有什么优势? 2016-04-11

- 企业网站如何选择适合SEO的虚拟主机 2022-07-17

- 网站运营技巧中 如何选择网站虚拟主机 2013-07-31

- 虚拟主机使用独立IP的优势? 2022-07-21

- 成都虚拟主机的三个被忽视的功能 2023-03-08

- 企业为什么要用独享ip虚拟主机? 2021-03-15

- 企业网站建设使用虚拟主机 这几点要测一下 2016-08-06

- 北京网站建设之服务器和虚拟主机空间常见问题? 2021-05-31

- 美国虚拟主机为什么这么多人使用? 2022-10-04

- 网站选择虚拟主机几点建议 2022-09-23

- 免备案的虚拟主机选择哪家 2022-07-28