eclipse上搭建hadoop开发环境-创新互联

一、概述

1.实验使用的Hadoop集群为伪分布式模式,eclipse相关配置已完成;

2.软件版本为hadoop-2.7.3.tar.gz、apache-maven-3.5.0.rar。

二、使用eclipse连接hadoop集群进行开发

1.在开发主机上配置hadoop

①将hadoop-2.7.3.tar.gz解压到本地主机上

②使用windows版本的hadoop中的bin替换目标中的bin文件夹

③配置windows上的hadoop环境变量

2.在eclipse上配置hadoop集群信息

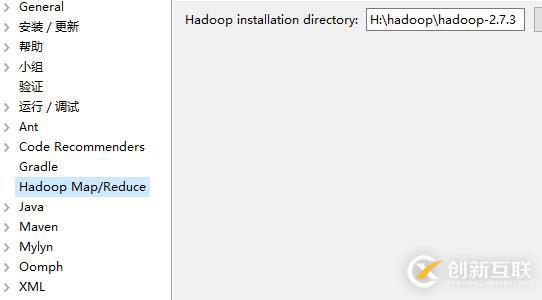

①在eclipse中添加hadoop路径

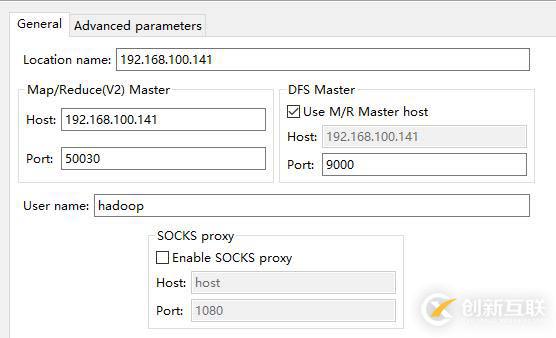

②配置hadoop集群访问信息

3.在hadoop集群中取消权限验证

hdfs-site.xml <property> <name>dfs.permissions</name> <value>false</value> </property>

4.创建一个文件测试连接权限

5.安装maven

①将maven解压到开发主机上

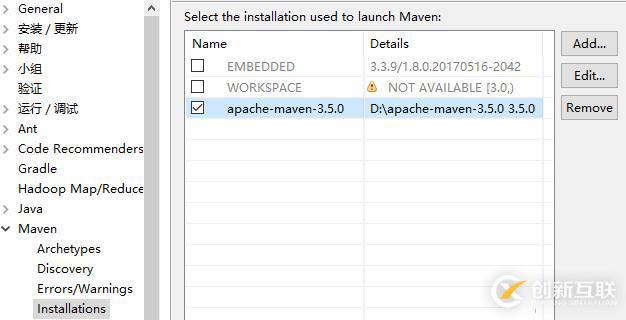

②在eclipse上添加maven路径

5.新建maven工程

6.修改maven配置文件(maven/pom.xml)

<dependencies> <dependency> <groupId>org.apache.hadoop</groupId> <artifactId>hadoop-client</artifactId> <version>2.7.3</version> </dependency> <dependency> <groupId>junit</groupId> <artifactId>junit</artifactId> <version>3.8.1</version> <scope>test</scope> </dependency> </dependencies>

7.新建一个类用于测试(WordCount)

import java.io.IOException;

import java.util.StringTokenizer;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.Mapper;

import org.apache.hadoop.mapreduce.Reducer;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;

import org.apache.hadoop.util.GenericOptionsParser;

public class WordCount {

public static class TokenizerMapper

extends Mapper<Object, Text, Text, IntWritable>{

private final static IntWritable one = new IntWritable(1);

private Text word = new Text();

public void map(Object key, Text value, Context context

) throws IOException, InterruptedException {

StringTokenizer itr = new StringTokenizer(value.toString());

while (itr.hasMoreTokens()) {

word.set(itr.nextToken());

context.write(word, one);

}

}

}

public static class IntSumReducer

extends Reducer<Text,IntWritable,Text,IntWritable> {

private IntWritable result = new IntWritable();

public void reduce(Text key, Iterable<IntWritable> values,

Context context

) throws IOException, InterruptedException {

int sum = 0;

for (IntWritable val : values) {

sum += val.get();

}

result.set(sum);

context.write(key, result);

}

}

public static void main(String[] args) throws Exception {

Configuration conf = new Configuration();

String[] otherArgs = new GenericOptionsParser(conf, args).getRemainingArgs();

if (otherArgs.length < 2) {

System.err.println("Usage: wordcount <in> [<in>...] <out>");

System.exit(2);

}

Job job = Job.getInstance(conf, "word count");

job.setJarByClass(WordCount.class);

job.setMapperClass(TokenizerMapper.class);

job.setCombinerClass(IntSumReducer.class);

job.setReducerClass(IntSumReducer.class);

job.setOutputKeyClass(Text.class);

job.setOutputValueClass(IntWritable.class);

for (int i = 0; i < otherArgs.length - 1; ++i) {

FileInputFormat.addInputPath(job, new Path(otherArgs[i]));

}

FileOutputFormat.setOutputPath(job,

new Path(otherArgs[otherArgs.length - 1]));

System.exit(job.waitForCompletion(true) ? 0 : 1);

}

}8.配置WordCount

①将log4j.properties移动到WordCount类下

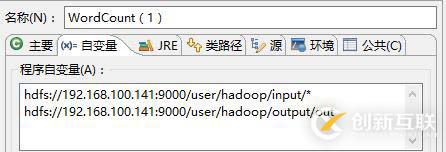

②设置WordCount的运行自变量

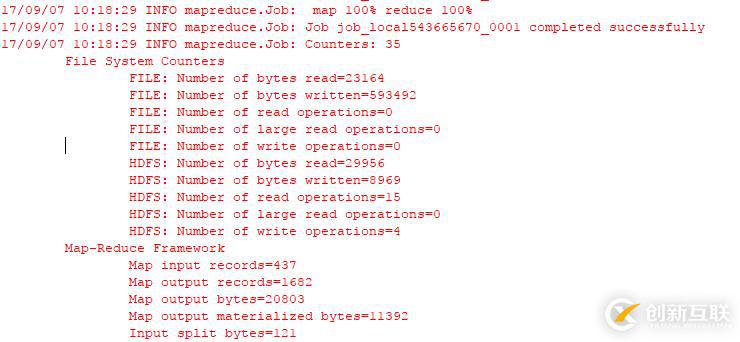

8.运行测试

三、jar包的导出与提交执行

1.导出WordCount

2.将导出的jar包上传到hadoop集群

[hadoop@hadoop ~]$ ls wc.jar

3.运行

[hadoop@hadoop ~]$ hadoop jar wc.jar WordCount /user/hadoop/input/* /user/hadoop/output/out 17/09/06 22:36:56 INFO client.RMProxy: Connecting to ResourceManager at hadoop/192.168.100.141:8032 17/09/06 22:36:57 INFO input.FileInputFormat: Total input paths to process : 1 17/09/06 22:36:58 INFO mapreduce.JobSubmitter: number of splits:1 17/09/06 22:36:58 INFO mapreduce.JobSubmitter: Submitting tokens for job: job_1504744740212_0001 17/09/06 22:36:59 INFO impl.YarnClientImpl: Submitted application application_1504744740212_0001 17/09/06 22:36:59 INFO mapreduce.Job: The url to track the job: http://hadoop:8088/proxy/application_1504744740212_0001/ 17/09/06 22:36:59 INFO mapreduce.Job: Running job: job_1504744740212_0001 17/09/06 22:37:36 INFO mapreduce.Job: Job job_1504744740212_0001 running in uber mode : false 17/09/06 22:37:36 INFO mapreduce.Job: map 0% reduce 0% 17/09/06 22:38:26 INFO mapreduce.Job: map 100% reduce 0% 17/09/06 22:38:42 INFO mapreduce.Job: map 100% reduce 100% 17/09/06 22:38:46 INFO mapreduce.Job: Job job_1504744740212_0001 completed successfully

4.查看运行结果

[hadoop@hadoop ~]$ hdfs dfs -cat /user/hadoop/output/out/part-r-00000 "AS 1 "GCC 1 "License"); 1 & 1 'Aalto 1 'Apache 4 'ArrayDeque', 1 'Bouncy 1 'Caliper', 1 'Compress-LZF', 1 ……

另外有需要云服务器可以了解下创新互联scvps.cn,海内外云服务器15元起步,三天无理由+7*72小时售后在线,公司持有idc许可证,提供“云服务器、裸金属服务器、高防服务器、香港服务器、美国服务器、虚拟主机、免备案服务器”等云主机租用服务以及企业上云的综合解决方案,具有“安全稳定、简单易用、服务可用性高、性价比高”等特点与优势,专为企业上云打造定制,能够满足用户丰富、多元化的应用场景需求。

网站栏目:eclipse上搭建hadoop开发环境-创新互联

路径分享:https://www.cdcxhl.com/article26/dsjccg.html

成都网站建设公司_创新互联,为您提供网页设计公司、用户体验、面包屑导航、建站公司、网站建设、自适应网站

声明:本网站发布的内容(图片、视频和文字)以用户投稿、用户转载内容为主,如果涉及侵权请尽快告知,我们将会在第一时间删除。文章观点不代表本网站立场,如需处理请联系客服。电话:028-86922220;邮箱:631063699@qq.com。内容未经允许不得转载,或转载时需注明来源: 创新互联

- 成都SEO教你在SEO中运用网站META标签优化 2023-04-17

- 企业网站标签优化有哪些作用? 2023-04-07

- 成都网站建设的网站首页头部title标签优化 2016-08-10

- 网站标签优化之网页标签优化技巧 2014-03-25

- 网站优化中细节:注意h1、h2、h3、strong标签优化 2021-07-26

- seo图片alt标签优化技巧 2022-09-28

- 网站标签优化技巧 2016-11-03

- SEO标签优化,网站流量快速提升! 2023-04-04

- 成都网站建设技术篇:网站tag标签优化思路分析原文链接 2022-11-06

- 网站标签优化原则与技巧 2018-02-16

- h标签优化的重要性有哪些? 2022-05-28

- 关于网站标签优化你了解多少 2021-09-02